Anticiparse a lo impensable: ¿Cómo pueden prepararse las empresas para la gestión de los incidentes de IA?

Los sistemas de AI su nivel de integración y transformación por su capacidad en el tejido empresarial es cada vez mayor, lo que pone en escena la necesidad de estrategias de gestión de incidentes sólidas y con visión de futuro. La tradicional gestión de respuesta a incidentes ya no es suficiente cuando se trata de gestionar las complejidades de las tecnologías de innovación emergente y disruptiva basada en AI.

Donde debemos tener presente sus características y particularidades únicas, como su naturaleza, probabilidades, sus capacidades de autoaprendizaje y su habilidad de operar de forma autónoma, lo cual subraya el replantearse el enfoque de la gestión de incidentes.

Por tanto, los sistemas de AI no son como los sistemas tradicionales. Por lo que la propia naturaleza de la AI basada en algoritmos de aprendizaje automático que predicen o generan contenido identificando patrones en grandes conjuntos de datos, demuestra lo difícil que pueden comportarse de formas complejas de predecir y controlar.

La AI es vulnerable a los ataques de actores maliciosos y propensa a errores, sesgos y comportamientos no intencionados.

La necesidad de un enfoque holístico en la gestión de AI

Un ciberincidente es aquel que afecta la confidencialidad, disponibilidad e integridad de los datos o de los sistemas de información. Para la Inteligencia Artificial (AI), las dimensiones de la ciberseguridad son esenciales; además, las organizaciones deben conocer de manera amplia y visible los aspectos relacionados con la AI desde el principio hasta el fin, lo cual facilitará un enfoque sistémico y holístico en la gestión de estos incidentes.

Tras la aprobación del Reglamento AI Act, muchas organizaciones han empezado a definir sus políticas de AI, pero no la definen correctamente, lo que exacerba en las brechas de sus estrategias de gestión y respuesta a incidentes.

Por tanto, de acuerdo con la OECD, lo principal que toda organización debe saber es que la AI se define como:

“Un sistema basado en una máquina que, por objetivos explícitos o implícitos, infiere, a partir de la entrada que recibe, cómo generar salidas tales como predicciones, contenidos, recomendaciones o decisiones que pueden influir en entornos físicos o virtuales. Los distintos sistemas de IA varían en sus niveles de autonomía y capacidad de adaptación tras su despliegue”.

Implementación de políticas y estrategias para la AI

Recientemente, las organizaciones están dejando de especificar lo que no es AI, lo que puede generar confusión al gestionar incidentes de esta naturaleza. La AI se está integrando cada vez más en aplicaciones, incluidas aquellas de uso tradicional. Por lo tanto, es fundamental considerar el alcance de la AI dentro de un sistema completo, incluyendo sus dependencias e integraciones, ya que esto será clave.

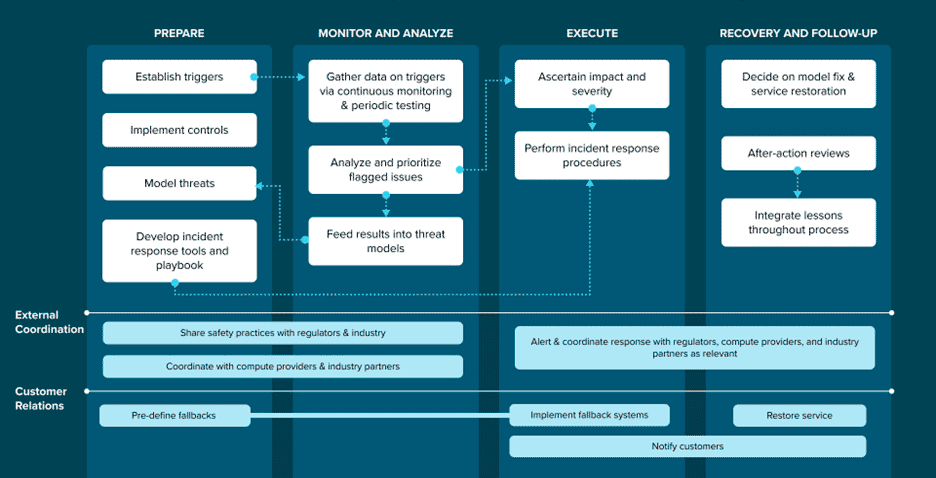

Por otra parte, el Institute for AI Policy and Strategy (IAPS) plantea un marco a alto nivel esbozando un proceso de cuatro fases inspirado en las prácticas de respuesta a ciberincidentes del National Institute of Standards and Technology (NIST), siendo las siguientes fases de preparación, monitoreo y análisis, ejecución y recuperación y seguimiento; lo cual permite determinar los enfoques de respuesta a incidentes para la inteligencia artificial.

Fuente: IAPS. Proceso integral para aplicar la gestión de incidentes de AI

Fuente: IAPS. Proceso integral para aplicar la gestión de incidentes de AI

Fase 1: Preparación

- Modelo de gobernanza de AI: Establecimiento de modelos de gobernanza claros para agilizar la toma de decisiones en situaciones críticas, orientado a las prácticas regulatorias de AI Act.

- Gestión de riesgos: Mejora y fortalece la preparación mediante la integración de la evaluación integral de riesgos en los marcos de seguridad y privacidad de AI. Además, evaluar las interdependencias más amplias dentro de las cadenas de suministro y los ecosistemas así sean terceras, cuartas y enésimas partes.

- Capacidad interna de la organización: Crear herramientas, procedimientos y marcos de toma de decisiones para responder rápidamente a los incidentes. Esto incluye la identificación de amenazas, el establecimiento de medidas correctivas y de mitigación en conjunto a la definición de protocolos de respuesta.

- Gestión de la continuidad: La definición de soluciones alternativas ayuda a mitigar el impacto de las interrupciones del servicio en los usuarios, garantizando la resistencia y la fiabilidad.

- Enfoque en ciberresiliencia: Ampliación de la preparación para incluir controles de defensa proactivos, intercambio de inteligencia sobre amenazas y simulaciones basadas en escenarios para incidentes de ciberseguridad impulsados por IA e inclusive aquellos que no tengan connotación “ciber”, hay que tener presente la privacidad.

- Gestión de crisis: Establecer un plan de respuesta estructurado que integre la gestión de incidentes de AI con estrategias más amplias de ciberseguridad, privacidad y continuidad del negocio.

Fase 2: Monitorización y análisis

- Recolección de datos: Disponer de la visibilidad correspondiente del modelo o sistema de AI para recopilar datos de diversas fuentes en aras de evaluar las capacidades, el comportamiento y el uso de un modelo o sistema de AI en tiempo real.

- Detección de anomalías: Tras la recopilación de datos es muy relevante el análisis para identificar anomalías y los incidentes según su categorización y así escalar a los responsables de la toma de decisiones para una intervención oportuna.

- Integración con modelados de amenazas: Los resultados pertinentes según se considere podrían ser incorporado a los procesos de modelado de amenazas para mejorar las capacidades de las medidas de seguridad y fortalecer la madurez de las evaluaciones de riesgos de AI.

Fase 3: Ejecución

- Decisión e implementación de acciones de mitigación: En cuanto se ha identificado un incidente de AI es preciso determinar las acciones correctivas y ejecutar los ajustes necesarios en el modelo o sistema.

- Cumplimiento regulatorio: Notificar, alertar y colaborar con las autoridades reguladoras pertinentes para garantizar la alineación con las normas legales y del sector.

- Mitigación del impacto: Valorar la implementación de medidas alternativas y la notificación a las partes interesadas según alcance del modelo o sistema en aras de garantizar que ante una interrupción mínima se puedan evitar disturbios mayores.

Fase 4: Recuperación y seguimiento

- Recuperación y restauración: Las acciones se centran en el modelo o sistema de AI para restablecer la funcionalidad normal de los servicios afectados y garantizar las operaciones del negocio.

- Lecciones aprendidas: Realización de revisiones exhaustivas del incidente para extraer lecciones clave y mejorar las estrategias de respuesta futuras. Además, garantizar que las conclusiones de los incidentes sirvan de base para actualizar las políticas, mejorar la gobernanza de AI y aplicar las mejores prácticas en todo el sector.

- Colaboración y cooperación externa: Compartir conocimientos e intercambio de información con reguladores y socios del sector refuerza la preparación y alinea las estrategias de respuesta en todo el ecosistema.

■ Aquí te comparto algunas bases de datos de Incidentes de AI como fuentes de información, lo cual permite tener una panorámica de lo que está ocurriendo, tal como el MIT AI Incident Tracker, AIID AI Incident Database, AI Controversy Repository, MITRE AI Risk Database, OECD AI Incidents Monitor (AIM), DAIL The Database of AI Litigation, Label Errors Database, Goals, Methods, and Failures (GMF) y el Center for Security and Emerging Technology (CSETv1), lo cual pueden ser de gran ayuda y utilidad su organización.

Conclusión

En una era en la que los sistemas de AI están cada vez más integrados en operaciones críticas, es esencial contar con un marco sólido de respuesta a incidentes.

El futuro de los incidentes de AI no se basa únicamente en reaccionar ante, sino en anticiparse a ellos antes de que ocurran.

A medida que los modelos o sistemas de inteligencia artificial se vuelven más sofisticados e integrados en infraestructuras críticas, su resiliencia frente a incidentes ya no es opcional, sino fundamental. Mediante la implementación de un enfoque estructurado que incluya la preparación, la supervisión, la ejecución y el seguimiento posterior al incidente, las organizaciones pueden asegurar respuestas rápidas y efectivas, así como mejoras sostenibles en la seguridad, la privacidad y la confiabilidad.

El futuro de los incidentes de AI no se basa únicamente en reaccionar ante, sino en anticiparse a ellos antes de que ocurran.

Sin embargo, la verdadera resiliencia va más allá de los controles internos. El futuro de AI depende de una gobernanza proactiva, un aprendizaje continuo y un compromiso con la adaptabilidad, porque en el panorama en rápida evolución de la inteligencia artificial, la mejor defensa es una estrategia preparada, receptiva y con visión de futuro.

De manera similar a como los frenos permiten a los automóviles moverse más rápido al proporcionar control a los conductores, un plan de respuesta a incidentes de IA bien elaborado permite a las organizaciones acelerar la adopción de la IA al asegurar que pueden abordar y recuperarse rápidamente de posibles problemas. Con las estrategias adecuadas, las organizaciones pueden aprovechar el poder de la IA con confianza, sabiendo que están preparadas para cualquier desafío que pueda surgir.

Cloud Híbrida

Cloud Híbrida Ciberseguridad

Ciberseguridad Data & AI

Data & AI IoT y Conectividad

IoT y Conectividad Business Applications

Business Applications Intelligent Workplace

Intelligent Workplace Pequeña y Mediana Empresa

Pequeña y Mediana Empresa Salud

Salud Industria

Industria Retail

Retail Turismo y Ocio

Turismo y Ocio Transporte y Logística

Transporte y Logística Energía y Utilities

Energía y Utilities Banca y Finanzas

Banca y Finanzas Ciudades Inteligentes

Ciudades Inteligentes Sector Público

Sector Público