Sesgos en la IA (II): Clasificación de los sesgos

Ya hemos visto en el primer capítulo de esta serie el concepto de sesgos y otros conceptos afines, como por ejemplo uno particularmente relevante: la discriminación. Una vez analizados los citados conceptos es fundamental identificarlos y clasificarlos para poder tratar los riesgos derivados. Empezamos por los sesgos.

El National Institute of Standards and Technology (NIST) —agencia del gobierno de los EE. UU. encargada de promover la innovación y la competencia industrial— publicó en marzo de 2022 la NIST Special Publication 1270 con el título Towards a Standard for Identifying and Managing Bias in Artificial Intelligence cuyo objetivo es ofrecer una guía para futuro estándares en identificación y gestión de sesgos.

Este documento:

- Por un lado describe lo que está en juego y el desafío del sesgo en la IA y proporciona ejemplos de cómo y por qué puede socavar la confianza pública;

- Por otro lado identifica tres categorías de sesgos en la IA (sistémico, estadístico y humano) y describe cómo y dónde contribuyen a los daños;

- Y por último describe tres grandes desafíos para mitigar el sesgo: conjuntos de datos, pruebas y evaluación, y factores humanos, e introduce orientaciones preliminares para abordar a ellos.

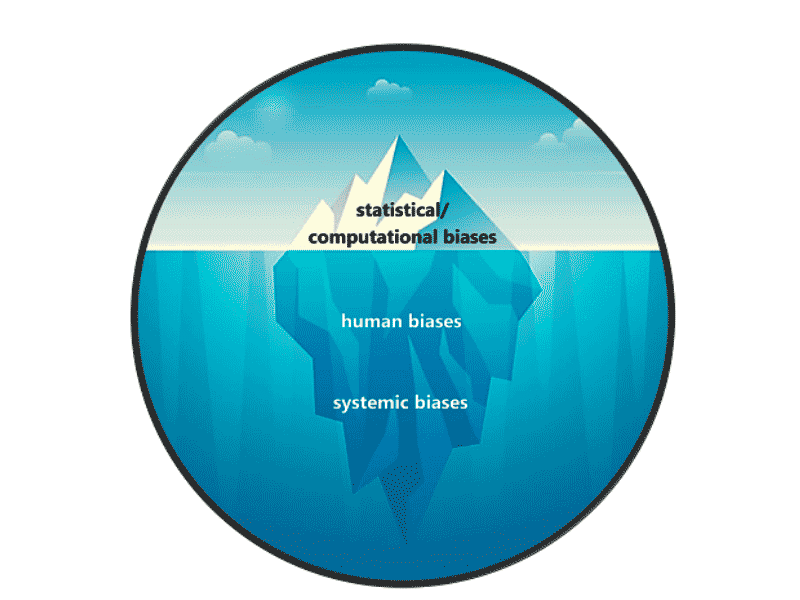

Como decíamos y según el NIST, existen tres tipos de sesgos que afectan a los sistemas basados en Inteligencia Artificial: los sesgos computacionales o estadísticos, los sesgos humanos y los sesgos sistémicos.

Vamos a desarrollar dichos tres tipos de sesgos que indica el NIST, complementando dicha clasificación con más detalle y puntos de vista propios.

1. Los sesgos computacionales

Son aquellos que podemos medir a partir de un modelo de Inteligencia Artificial ya entrenado. Son la punta del iceberg y, aunque se pueden tomar medidas para subsanarlos, no constituyen todas las fuentes de posibles sesgos que intervienen.

Los sesgos estadísticos o computacionales surgen a partir de errores que resultan cuando la muestra no es representativa de la población. Estos sesgos surgen de factores sistemáticos y no aleatorios.

El error puede ocurrir sin que haya prejuicio, parcialidad o intención discriminatoria.

En los sistemas de IA, estos sesgos están presentes en los conjuntos de datos y procesos algorítmicos utilizados en el desarrollo de aplicaciones de IA y, a menudo, surgen cuando los algoritmos se entrenan en un tipo de datos y no puede extrapolar más allá de esos datos.

Aquí podemos encontrar varios tipos a su vez:

- a. Sesgo de Selección de Datos: se produce cuando los datos utilizados para entrenar un modelo no representan de manera equitativa la realidad.

—Por ejemplo, si un algoritmo de contratación se entrena principalmente con currículos de hombres, podría sesgar las decisiones hacia candidatos masculinos. - b. Sesgo Algorítmico: se produce cuando los algoritmos favorecen ciertos resultados o a ciertos grupos.

—Por ejemplo, un sistema de crédito que penaliza automáticamente a personas de bajos ingresos debido a su historial financiero podría tener un sesgo algorítmico.

2. Los sesgos humanos

Son aquellos que tenemos cada uno de nosotros de manera implícita y que afectan a cómo percibimos e interpretamos la información que recibimos.

Los prejuicios humanos reflejan errores sistemáticos en el pensamiento humano basados en un número limitado de principios heurísticos y predicción de valores hasta operaciones de juicio más simples. Se conocen también como sesgos cognitivos al estar relacionados con la forma en que los seres humanos procesamos información y en cómo tomamos decisiones a partir de ella.

Dentro del sesgo humano podemos encontrar diversas categorías:

- a. Sesgo de Confirmación: se produce cuando el sistema de IA se basa en creencias o asunciones preexistentes en los datos, ya que existe una tendencia a buscar, interpretar y recordar aquellos datos que refuerzan dichas creencias u opiniones preexistentes.

—Por ejemplo, si un algoritmo de recomendación de películas solo sugiere géneros específicos a un usuario, podría reforzar sus preferencias anteriores. - b. Sesgo de Anclaje: se produce cuando hay una dependencia excesiva de la primera información o ancla.

—Por ejemplo, si un sistema de precios en línea muestra un precio inicial alto, los usuarios pueden percibir como 'oferta' o precio barato cualquier precio inferior a ese anclaje inicial. - c. Efecto Halo: valorar a una persona o cosa en función de una característica sobresaliente.

—Por ejemplo, asumir que un candidato con una universidad prestigiosa en su currículo es automáticamente más competente. - d. Sesgo de Negatividad: se produce cuando se da un peso mayor a la información negativa que a la positiva.

—Por ejemplo, imaginemos un sistema de detección de fraudes podría ser más propenso a identificar falsos positivos debido a este sesgo derivado de que está entrenado con información 'negativa'.

Estos sesgos humanos se introducen en los sistemas de IA de diversas formas:

- Durante su desarrollo (por ejemplo, al programar un sistema de crédito introduciendo perjuicios humanos existentes).

- En el entrenamiento (por ejemplo, por utilizar datos de entrenamiento masculinos en un proceso de selección).

- En el etiquetado (si hay errores o sesgos en el etiquetado humano que introducen dicho sesgo en los datos).

- Por las funciones de pérdida y optimización (si penaliza más unos errores que otros también puede penalizar a ciertos grupos o a ciertas características).

3. Los sesgos sistémicos

Y, por último, los sesgos sistémicos son aquellos que se encuentran integrados en la sociedad y en las instituciones por razones históricas. No tiene por qué ser el resultado de ningún prejuicio o prejuicio consciente sino más bien de que la mayoría siga reglas o normas existentes.

Estos sesgos están presentes en los conjuntos de datos utilizados en IA, y las normas, prácticas y procesos institucionales a lo largo del ciclo de vida de la IA y en cultura y sociedad más amplias. El racismo y el sexismo son los ejemplos más comunes.

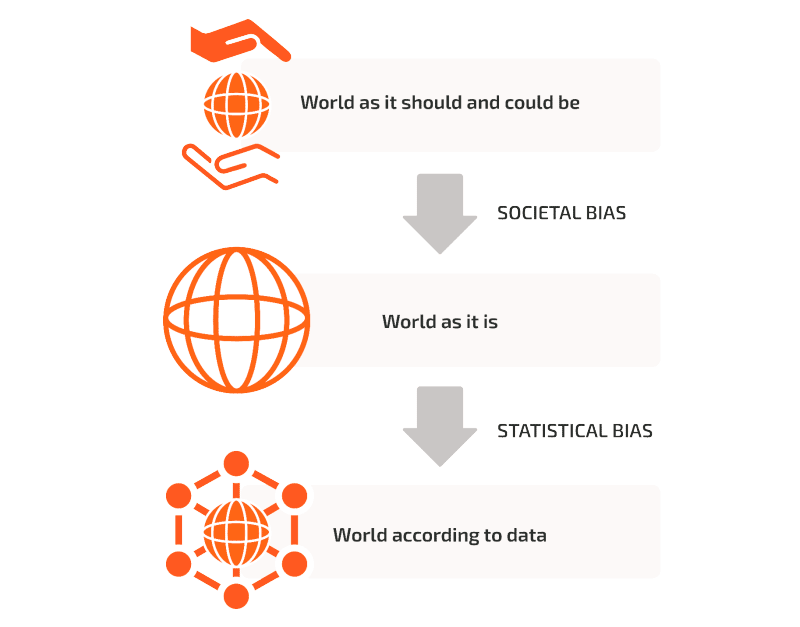

Por su parte, en la guía práctica de Rhite, se distinguen las dos principales categorías de sesgos que existen:

- Por un lado el sesgo social, relativo a los prejuicios, estereotipos o inclinaciones arraigados en una cultura o sociedad, de los que el sesgo histórico es un ejemplo.

- y por otro lado el sesgo estadístico que supone una diferencia sistemática entre un parámetro estimado en los datos y su valor real en el mundo real y se produce cuando los datos no logran capturar con precisión las variables o fenómenos previstos, lo que genera resultados de IA defectuosos, como los sesgos de representación, y de medición.

Asimismo, añade los sesgos cognitivos que:

"Son errores sistemáticos en el pensamiento que pueden afectar el juicio y la toma de decisiones".

Entre estos se encuentram por ejemplom el más común que es el sesgo de confirmación, en el que las personas tienden a buscar o dar más peso a los datos que confirman sus ideas o hipótesis preexistentes.

A su vez, el RIA en su artículo 14.4.b) recoge el sesgo de automatización que consiste en

"Posible tendencia a confiar automáticamente o en exceso en los resultados de salida generados por un sistema de IA (…)”.

Este tipo de sesgo está estrechamente relacionado con los sesgos de confirmación y de anclaje, categorías pertenecientes a los sesgos cognitivos/humanos:

- Con respecto al sesgo de confirmación, la tendencia a buscar información que confirme nuestras creencias previas puede reforzar la confianza en los resultados de los sistemas de IA, incluso cuando estos cometan errores.

- En relación con el sesgo de anclaje, la dependencia excesiva en la información inicial podría conllevar una predisposición a confiar automáticamente en las sugerencias del sistema de IA (que funcionarían como un 'ancla').

Fuente: Rhite.

Fuente: Rhite.

Conclusión

La identificación y clasificación de los sesgos que afectan a la IA es de relevante importancia para poder prevenir y gestionar los riesgos derivados de aquellos sesgos que pueden producir daños y vulnerar los derechos y libertades de las personas.

En este sentido, en este capítulo hemos identificado las principales categorías de sesgos con implicancias en los sistemas de IA, siendo estos: los sesgos computacionales que provienen de errores en los resultados de los sistemas de IA; los sesgos humanos que provienen de las personas que participan en los procesos de un sistema de IA (programación, clasificación, etc.) y los sistémicos que afectan a la sociedad en su conjunto.

■ En el siguiente capitulo nos adentraremos en la clasificación de los tipos de discriminación.

MÁS DE ESTA SERIE

Cloud Híbrida

Cloud Híbrida Ciberseguridad

Ciberseguridad Data & AI

Data & AI IoT y Conectividad

IoT y Conectividad Business Applications

Business Applications Intelligent Workplace

Intelligent Workplace Pequeña y Mediana Empresa

Pequeña y Mediana Empresa Salud

Salud Industria

Industria Retail

Retail Turismo y Ocio

Turismo y Ocio Transporte y Logística

Transporte y Logística Energía y Utilities

Energía y Utilities Banca y Finanzas

Banca y Finanzas Ciudades Inteligentes

Ciudades Inteligentes Sector Público

Sector Público